在互联网的海洋中,搜索引擎的爬虫(搜索机器人)不断地遍历网页,索引新内容,以供搜索引擎用户检索。但作为网站管理员,你可能不希望爬虫访问网站的某些部分。这就是robots.txt文件发挥作用的地方。本文将对robots.txt文件进行深入解析,并提供如何正确设置它的指导。

什么是robots.txt文件?

robots.txt是一个文本文件,网站管理员创建并放置在网站的根目录中,用于告诉爬虫哪些页面可以被访问,哪些不可以。robots.txt文件是网站与搜索引擎爬虫沟通的第一手段,它基于“爬虫排除协议”(Robots Exclusion Protocol),大多数爬虫在访问网站之前会检查这个文件。

如何正确设置robots.txt文件?

正确设置robots.txt文件不仅能保护网站的隐私内容,还能帮助搜索引擎更高效地索引网站的有价值内容。以下是一些设置robots.txt的基本步骤和最佳实践。

步骤1:确定网站结构

在编写robots.txt文件之前,你需要了解网站的目录结构以决定哪些部分不应该被爬虫访问。这可能包含了包括但不限于包含敏感信息的目录、临时或测试页面、重复内容或归档资料等。

步骤2:编写规则

robots.txt文件由一系列的规则组成,每条规则指定了针对特定爬虫的允许或禁止访问的指令。这些规则的基本格式如下:

User-agent: 指定规则适用于哪个爬虫。使用*代表所有爬虫。Disallow: 指定不允许爬虫访问的路径。Allow: 明确指定允许爬虫访问的路径(一些爬虫不支持此指令)。

这里有一个简单的示例:

User-agent: *

Disallow: /private/

Allow: /public/

这告诉所有爬虫可以访问/public/目录,但不可以访问/private/目录。

更多示例参考:

示例1:阻止所有爬虫访问整个网站

User-agent: *

Disallow: /

示例2:允许所有爬虫访问整个网站

User-agent: *

Disallow:

(注意:Disallow后面没有斜杠表示允许访问所有内容)

示例3:禁止所有爬虫访问某个特定目录

User-agent: *

Disallow: /private/

示例4:禁止所有爬虫访问某个特定文件

User-agent: *

Disallow: /private/directory/file.html

示例5:对特定的爬虫设置规则

User-agent: Googlebot

Disallow: /private/

上面的规则只对Google的爬虫生效。

步骤3:添加Sitemap位置

如果你有站点地图(Sitemap),建议在robots.txt文件中指明其位置:

Sitemap: http://www.example.com/sitemap.xml

这可以帮助爬虫更效率地发现网站的所有页面。

步骤4:保存并上传文件

将你的robots.txt文件保存为纯文本格式,并上传到网站的根目录中。确保文件名为“robots.txt”,因为这是爬虫默认寻找的文件名。

步骤5:测试设置

在生产环境中应用robots.txt文件之前,使用如Google Search Console等工具进行测试,以确保它不会意外地阻止爬虫访问重要内容。

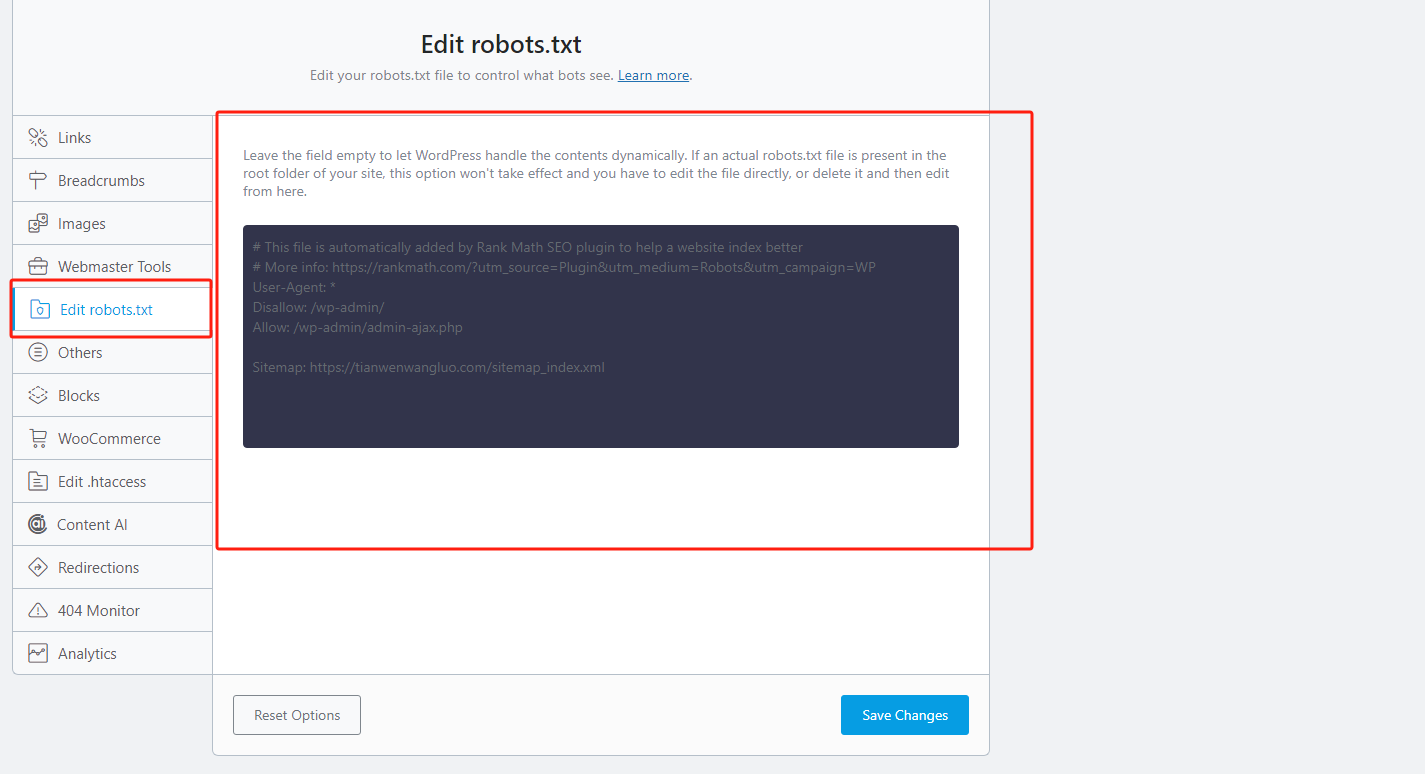

如果你是用WordPress搭建的网站,有更简单的方式,你只需要安装好seo插件即可,插件会自动为你设定好正确的robots.txt

注意事项

- 明确指令:确保你的

Disallow和Allow指令明确具体,避免使用模糊的路径。 - 不要禁止重要内容:避免使用

robots.txt文件禁止搜索引擎访问重要的网页或网站区域。 - 保持更新:随着网站的变化,定期更新

robots.txt文件是很重要的。 - 谨慎使用通配符:在使用通配符(比如

*)时要小心,因为不当使用可能会导致意料之外的页面被屏蔽。 - 优化爬虫流量:合理设置

robots.txt可以优化爬虫对服务器资源的使用,防止服务器超载。 - 注意隐私:

robots.txt文件本身是公开的,任何人都可以看到。因此,不要在文件中列出敏感目录,以免引来不必要的关注。